Deepfakes 2026: Wenn KI Ihr Gesicht und Ihre Stimme fälscht

Was vor wenigen Jahren noch nach Science-Fiction aussah, ist inzwischen für nahezu jeden verfügbar. Ein einziges Foto reicht heute oft aus, um täuschend echte Videos zu erzeugen. Stimmen können innerhalb weniger Minuten geklont werden. Gesichter lassen sich in fremde Aufnahmen einsetzen. Teilweise wirken die Ergebnisse inzwischen so echt, dass selbst geschulte Betrachter Schwierigkeiten haben, Manipulationen zu erkennen.

Die Folgen reichen von peinlichen Fälschungen bis hin zu massiven Persönlichkeitsrechtsverletzungen, Betrugsfällen und digitaler Gewalt.

Was sind Deepfakes überhaupt?

Deepfakes sind mit künstlicher Intelligenz manipulierte oder vollständig künstlich erzeugte Bild-, Audio- oder Videoaufnahmen. Ziel ist regelmäßig, eine echte Person möglichst glaubwürdig nachzuahmen.

Besonders problematisch:

Die technische Einstiegshürde sinkt rapide. Was früher Spezialwissen und Hochleistungsrechner erforderte, funktioniert heute teilweise direkt im Browser oder per Smartphone-App.

KI kann mittlerweile:

- Stimmen imitieren

- Lippenbewegungen synchronisieren

- Gesichter austauschen

- komplette Videos erzeugen

- scheinbar echte Videotelefonate simulieren

Damit entsteht ein völlig neues Missbrauchspotential.

„Früher musste man heimlich filmen. Heute reicht ein Foto.“

Genau darin liegt die eigentliche Gefahr.

Deepfakes ermöglichen erstmals die massenhafte Herstellung scheinbar echter Inhalte, ohne dass die betroffene Person jemals anwesend war.

Besonders häufig betroffen sind:

- Frauen

- Prominente

- Politiker

- Influencer

- Unternehmer

- ehemalige Partner

- Minderjährige

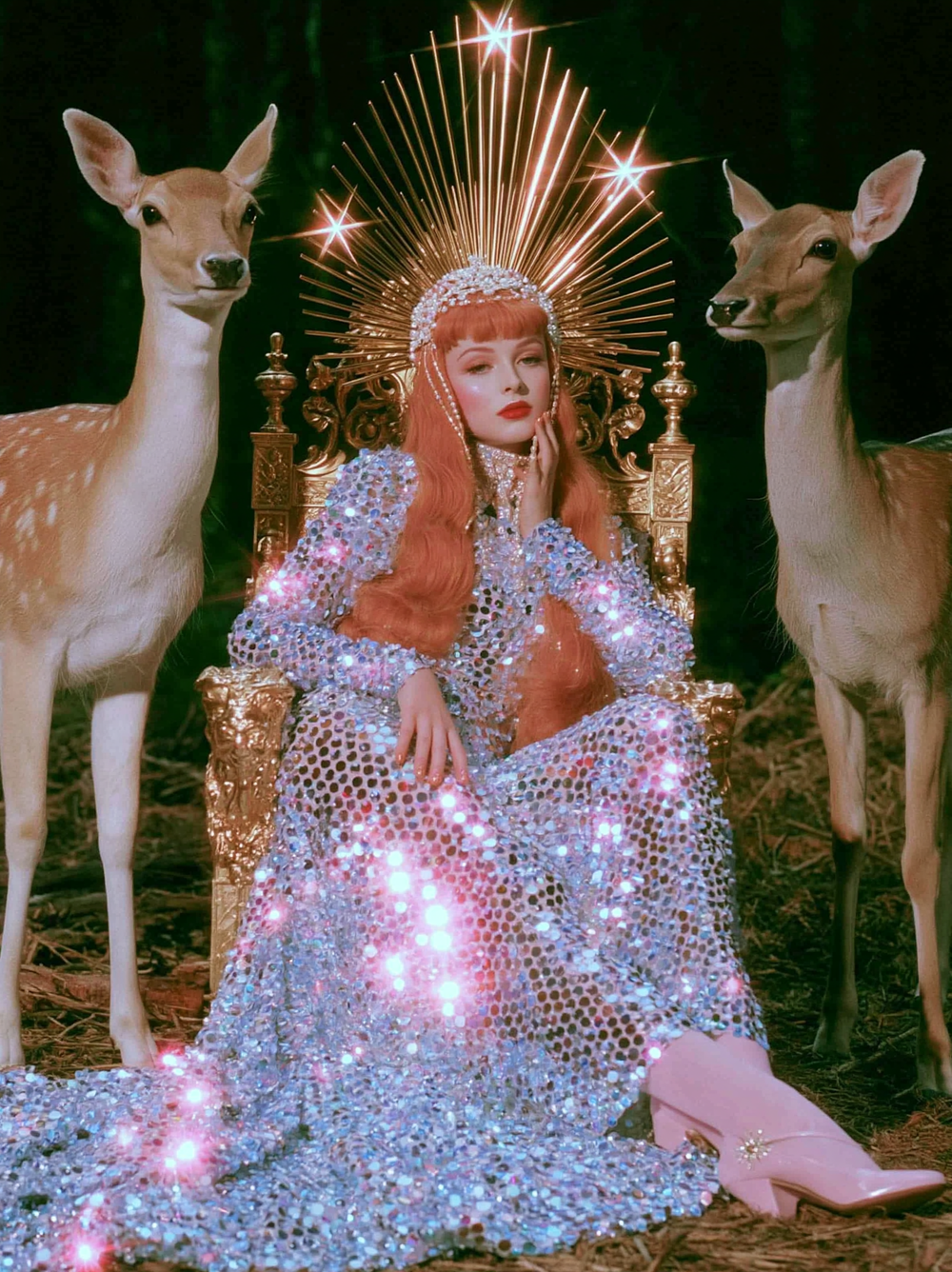

Ein besonders drastisches Problem ist die sogenannte Deepfake-Pornografie. Hier werden Gesichter realer Personen mittels KI in pornografische Videos eingefügt. Die betroffenen Personen haben mit den Aufnahmen tatsächlich nichts zu tun – dennoch verbreiten sich die Inhalte oft millionenfach.

Für Betroffene ist der Schaden enorm:

Rufschädigung, psychische Belastung, soziale Ausgrenzung und Kontrollverlust über die eigene digitale Identität.

Das deutsche Recht war auf Deepfakes nicht vorbereitet

Das eigentliche Problem:

Die meisten deutschen Gesetze stammen aus einer Zeit, in der KI-gestützte Identitätsfälschungen praktisch undenkbar waren.

Trotzdem bestehen bereits heute verschiedene rechtliche Möglichkeiten gegen Deepfakes vorzugehen.

Betroffen sind insbesondere:

- das allgemeine Persönlichkeitsrecht

- das Recht am eigenen Bild (§§ 22, 23 KUG)

- datenschutzrechtliche Vorschriften der DSGVO

- strafrechtliche Vorschriften wie §§ 185 ff. StGB oder § 201a StGB

Die Rechtsprechung behandelt manipulierte Darstellungen bereits heute teilweise wie klassische Fotomontagen oder ehrverletzende Bildmanipulationen.

Das Problem ist allerdings:

Deepfakes gehen technisch und gesellschaftlich weit über klassische Bildbearbeitung hinaus.

Denn erstmals können komplette Identitäten simuliert werden.

Wenn selbst Videoanrufe kein sicherer Beweis mehr sind

Besonders brisant wird das Thema im Bereich Betrug.

International häufen sich Fälle, in denen Geschäftsführer mittels KI-Stimmen imitiert werden. Mitarbeiter erhalten scheinbar echte Video- oder Telefonanweisungen ihres Chefs und veranlassen hohe Überweisungen.

Teilweise sprechen Ermittler bereits von einer neuen Generation des „CEO-Fraud“.

Auch Privatpersonen geraten zunehmend ins Visier:

- Enkeltrick mit KI-Stimmen

- gefälschte Sprachnachrichten

- manipulierte Videobotschaften

- KI-generierte Dating-Betrugsmaschen

Das verändert grundlegend, wie digitale Kommunikation künftig bewertet werden muss.

Denn bisher galt oft:

„Ich habe es doch mit eigenen Augen gesehen.“

Genau dieses Vertrauen zerstören Deepfakes.

Strafbar? Teilweise ja – aber mit erheblichen Lücken

Juristisch ist die Lage kompliziert.

Deepfakes können bereits heute verschiedene Straftatbestände erfüllen:

- Beleidigung (§ 185 StGB)

- Nachstellung (§ 238 StGB)

- Betrug (§ 263 StGB)

- Verletzung der höchstpersönlichen Lebenssphäre (§ 201a StGB)

Die bestehenden Vorschriften erfassen viele Fälle allerdings nur indirekt.

Deshalb wird inzwischen über eigene Deepfake-Straftatbestände diskutiert. Hintergrund ist die Erkenntnis, dass klassische Gesetze nur begrenzt auf KI-Manipulationen zugeschnitten sind.

Vor allem bei Deepfake-Pornografie und politischer Desinformation sehen viele Juristen erhebliche Schutzlücken.

Plattformen reagieren oft zu langsam

Ein weiteres Problem:

Selbst wenn Deepfakes rechtswidrig sind, verbreiten sie sich häufig schneller, als Gerichte oder Plattformen reagieren können.

Bis Inhalte gelöscht werden:

- wurden sie oft bereits kopiert,

- auf anderen Plattformen erneut hochgeladen,

- oder millionenfach geteilt.

Die praktische Rechtsdurchsetzung ist deshalb häufig schwierig.

Gerade anonyme Täter, internationale Plattformen und die Geschwindigkeit sozialer Netzwerke machen Betroffenen die Verteidigung ihrer Rechte enorm schwer.

Die EU reagiert – zumindest teilweise

Mit dem neuen EU AI Act versucht die Europäische Union erstmals, Deepfakes gezielt zu regulieren.

Künftig gelten insbesondere Transparenzpflichten:

KI-generierte Inhalte sollen grundsätzlich als solche gekennzeichnet werden müssen.

Verstöße können erhebliche Bußgelder nach sich ziehen.

Das Grundproblem bleibt allerdings bestehen:

Auch gekennzeichnete Deepfakes können sich viral verbreiten und erheblichen Schaden anrichten.

Was Betroffene sofort tun sollten

Wer von einem Deepfake betroffen ist, sollte möglichst schnell handeln.

Wichtig sind insbesondere:

- Screenshots und Beweissicherung

- Speicherung von URLs

- anwaltliche Prüfung

- Löschungsaufforderungen

- Plattformmeldungen

- ggf. Strafanzeige

- einstweiliger Rechtsschutz

Gerade die ersten Stunden können entscheidend sein.

Deepfakes sind nicht nur ein Technikproblem – sondern ein Rechtsproblem

Die Diskussion um künstliche Intelligenz wird häufig technisch geführt.

Tatsächlich geht es aber zunehmend um fundamentale Rechtsfragen:

- Wem gehört die eigene digitale Identität?

- Wie schützt man Persönlichkeit im KI-Zeitalter?

- Was gilt künftig überhaupt noch als „Beweis“?

- Wie geht das Recht mit künstlich erzeugter Realität um?

Die kommenden Jahre werden zeigen, ob das bestehende Recht ausreicht – oder ob Deepfakes eine grundlegende Neuordnung des digitalen Persönlichkeitsschutzes erzwingen.

Fest steht jedenfalls:

KI kann heute nicht nur Texte schreiben.

Sie kann inzwischen Menschen imitieren. Täuschend echt.

Und genau deshalb werden Deepfakes eines der wichtigsten Rechtsprobleme der nächsten Jahre werden.